WASHINGTON D.C. — Pembicaraan strategis antara perusahaan kecerdasan buatan (AI) terkemuka, Anthropic, dan Departemen Pertahanan Amerika Serikat telah berakhir tanpa kesepakatan, memicu spekulasi luas mengenai masa depan kolaborasi teknologi dan militer di era 2026.

Sumber internal mengindikasikan bahwa perpecahan mendalam terjadi akibat perbedaan fundamental dalam kerangka etika pengembangan AI dan kontrol atas implementasi sistem otonom dalam aplikasi militer. Ini menyoroti tantangan kompleks yang dihadapi negara-negara adidaya dalam mengintegrasikan inovasi pesat AI dengan prinsip-prinsip keamanan dan moral.

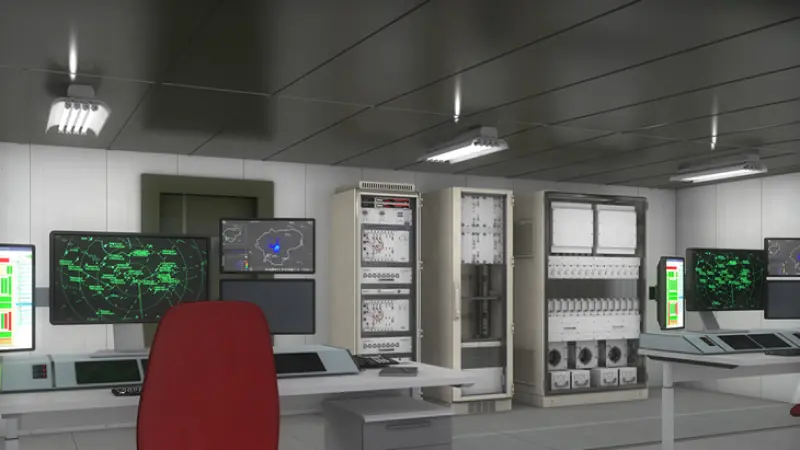

Departemen Pertahanan AS, pada tahun 2026 ini, semakin gencar mencari kemitraan dengan sektor swasta untuk mengamankan keunggulan teknologi di tengah persaingan geopolitik yang semakin ketat. Kecerdasan buatan dipandang sebagai komponen krusial dalam modernisasi pertahanan, mulai dari intelijen data hingga sistem senjata canggih.

Anthropic, yang dikenal dengan pendekatan berpusat pada keamanan dan etika dalam pengembangan AI, dilaporkan mengajukan serangkaian persyaratan ketat terkait penggunaan teknologi mereka. Ini termasuk batasan eksplisit pada aplikasi yang melibatkan sistem senjata otonom mematikan (LAWS) dan jaminan pengawasan manusia yang berkelanjutan.

“Mereka menginginkan kendali penuh atas bagaimana teknologi mereka diterapkan, yang seringkali bertentangan dengan kebutuhan operasional dan strategi militer kami,” ujar seorang pejabat senior Departemen Pertahanan yang enggan disebutkan namanya, merujuk pada ketegangan selama negosiasi.

Di sisi lain, perwakilan dari Anthropic menekankan pentingnya membangun “AI yang aman dan bermanfaat” yang tidak hanya efektif secara teknis tetapi juga bertanggung jawab secara moral. Mereka berpendapat bahwa terburu-buru mengintegrasikan AI tanpa kerangka etika yang kuat dapat menimbulkan konsekuensi yang tidak terduga dan berbahaya.

Kegagalan negosiasi ini tidak hanya berdampak pada Departemen Pertahanan AS dalam upayanya memodernisasi kemampuan militer, tetapi juga mengirimkan sinyal kuat kepada seluruh industri teknologi. Hal ini menggarisbawahi urgensi bagi perusahaan AI untuk menyeimbangkan potensi keuntungan dari kontrak pemerintah dengan komitmen terhadap prinsip-prinsip etis.

Diskusi yang berlangsung selama berbulan-bulan ini melibatkan berbagai pihak, mulai dari teknisi AI hingga pakar kebijakan dan pejabat tinggi pertahanan. Namun, perbedaan filosofis mengenai autonomi AI dan akuntabilitas tampaknya terlalu besar untuk dijembatani.

Para analis kebijakan teknologi berpendapat bahwa insiden ini mencerminkan tantangan yang lebih luas dalam mendefinisikan batas-batas kolaborasi antara sektor swasta yang inovatif dan entitas pemerintah yang berorientasi pada keamanan. “Ini bukan hanya tentang teknologi, tetapi juga tentang nilai-nilai dan tujuan akhir,” kata Dr. Elena Petrova, seorang pakar AI dan etika dari think tank Future Horizons Institute.

Implikasi dari kegagalan ini bisa meluas, berpotensi memperlambat pengembangan beberapa program AI militer strategis Amerika Serikat. Departemen Pertahanan kini mungkin harus mencari alternatif dari penyedia AI lain, yang mungkin tidak memiliki komitmen etika sekuat Anthropic.

Kejadian ini juga menambah tekanan pada pembuat kebijakan untuk merumuskan regulasi AI yang lebih jelas dan komprehensif. Perdebatan mengenai siapa yang seharusnya mengontrol teknologi yang begitu kuat dan memiliki potensi dampak global semakin mengemuka, terutama pada tahun 2026 ini ketika AI sudah menjadi bagian integral dari banyak aspek kehidupan.

Sementara itu, baik Anthropic maupun Departemen Pertahanan AS belum mengeluarkan pernyataan resmi yang merinci penyebab pasti kegagalan negosiasi. Namun, laporan internal menunjukkan bahwa kendala utama terletak pada perbedaan interpretasi mengenai “garis merah” etika yang tidak dapat dilanggar oleh Anthropic.

Peristiwa ini menegaskan bahwa meskipun potensi AI dalam aplikasi militer sangat besar, rintangan etika, kontrol, dan filosofis akan terus menjadi faktor penentu dalam kolaborasi antara inovator teknologi dan lembaga pertahanan di seluruh dunia.

Negosiasi yang kandas ini menjadi studi kasus penting tentang kompleksitas hubungan antara inovasi teknologi dan kebutuhan keamanan nasional, menunjukkan bahwa teknologi paling canggih sekalipun harus beroperasi dalam kerangka etika yang disepakati.